Deep Learningの最適化において、素人ながらLearning Rate(学習率)の値の調整も大事なのかな?と思っているのですが、Learning Rateの値はNeural Network全体の値の設定と、各Afiineでの設定が可能になっています。

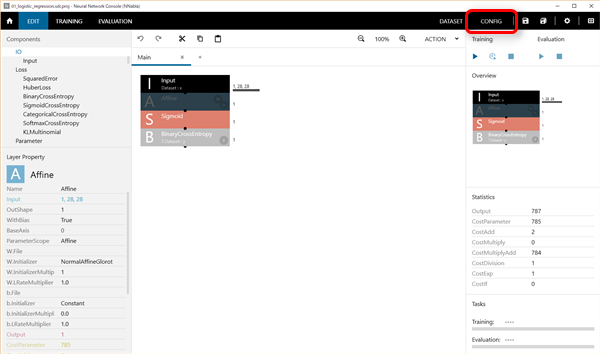

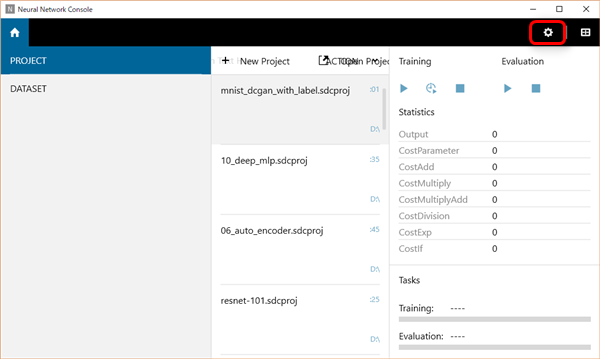

Neural Network全体のLearning Rateの値の設定は、プロジェクトを起動している状態で、右上にある、CONFIG をクリックします。

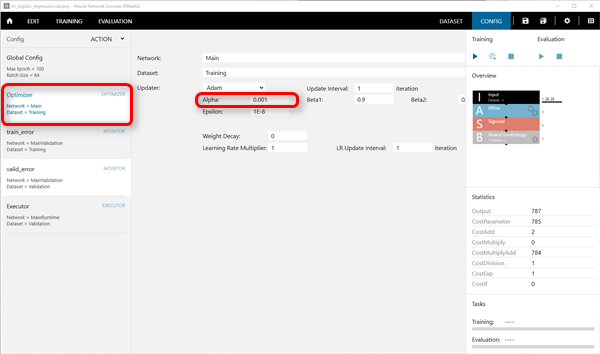

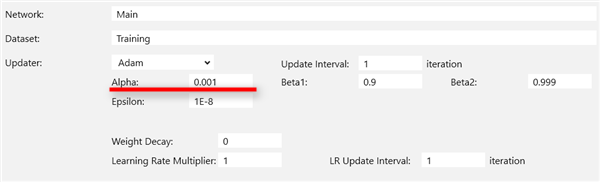

次に右側の Optimizer の部分をクリックすると、↓の画面ではAlphaの部分が学習率の値となります。

ここの表示は使用する更新の式(Updater)によって異なりますが、UpdaterがAdam(デフォルト)の時はAlphaの部分が学習率になります。

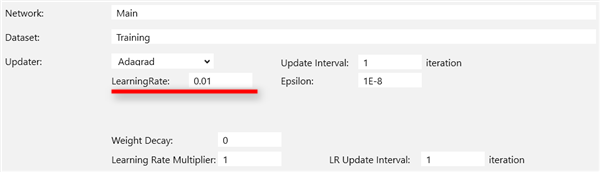

他のUpdaterの時(↓の例ではAdagrad)はLearningRateの部分がまさに学習率となります。

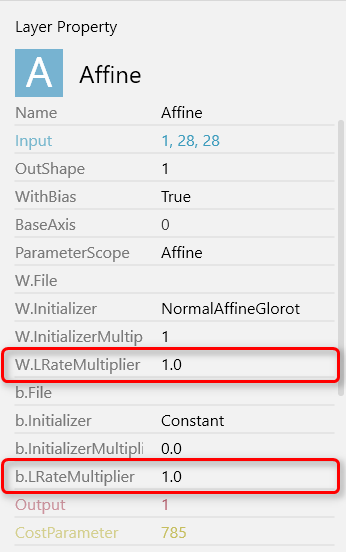

このLearningRateの値にさらに、各AfiineのプロパティにあるW.LRateMultiplier、b.LRateMultiplierの値を掛け合わせた値が学習率となります。

つまり、

重みの学習率は LearningRateの値 x W.LRateMultiplier

バイアスの学習率は LearningRateの値 x b.LRateMultiplier

となります。

Updaterの詳細については、ダウンロードしたファイルの中にあるpdfファイル(manual_ja.pdf)に書かれているので、確認すると良いかと思います。

←Deep Learningへ戻る

コメント