Udemyの動画による講座は、文字による説明よりも頭に入ってき易いので好きなのですが、たまにやっているキャンペーン期間中に勢いで

【キカガク流】人工知能・機械学習 脱ブラックボックス講座 – 初級編 –

![]()

なる講座を購入しました。

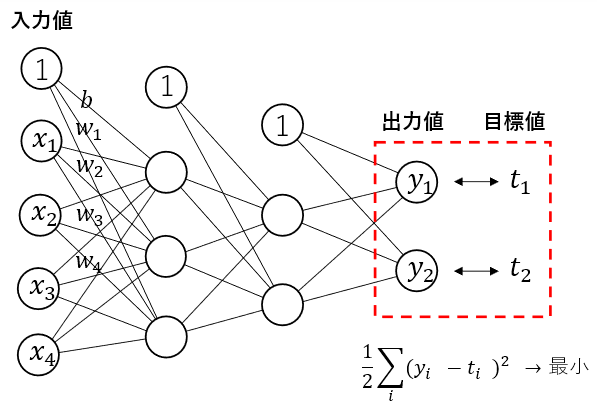

タイトルこそ、今どきウケの良い感じですが、前半は微分や偏微分などの数学的な説明で、後半はPythonの基礎(四則演算や条件分岐など)から、回帰をPythonで解くような内容です。

なので、内容に素直に私がタイトルを付けるなら、

最小二乗法を一から解いて、Pythonで実装してみよう!

という感じの内容です。

最小二乗法については、さんざんやって来たので、前半はあまり得る物が無かったのですが、Pythonに関しては、私はド素人なので、そこは参考になりました。

機械学習を学習する上では、二乗誤差の偏微分やPythonを使ったプログラムは、ほぼ、必須なので、必要な知識ではあるのですが、この講座の中で機械学習についての説明に相当する部分は単回帰分析の部分だけでしょうか。

この内容で、一番気になったポイントとして、最後の部分で入力データを部屋の広さ(平米数)として、出力を家賃を求める単回帰分析の演習問題があったのですが、部屋の広さ(平米数)を入力するとマイナスの家賃が出力されてしまい、これは外挿による推論となってしまうため、外挿とならないように、学習用のデータを増やしましょう!という説明だったのですが、半分あっている気もしますが、一番の問題は、 部屋の広さ⇔家賃 の関係を一次式で近似しちゃってるのが問題なのでは?とも思ったりもしました。

私が散々、最小二乗法でモデル式を作り、偏微分を解きながら、近似式を求めていた時は、誤差関数に変な特性、傾向が残らないか?(2次関数っぽい変化とか。。)や、入力データにあきらかな誤差データは含まれないか?など、気にしながら近似していましたが、機械学習とかになった瞬間、その辺の事が語られる事が少ないような。。

とは言いながらも、ちゃんと受講しましたよ。

やっぱり動画の講座はいいですね。

コメント